Várias empresas, incluindo Microsoft і Facebook, e até mesmo pesquisadores da University of Southern California, estão desenvolvendo tecnologias para combater os deepfakes e impedir sua disseminação pela mídia amarela e desinformação em geral. No entanto, um grupo de cientistas ainda conseguiu enganá-los.

Uma equipe de cientistas da computação da Universidade da Califórnia, em San Diego, alertou que ainda é possível enganar os sistemas existentes de detecção de deepfake inserindo dados de entrada chamados "exemplos concorrentes" em cada quadro de vídeo. Os cientistas apresentaram suas descobertas na WACV 2021 Computer Vision Conference, realizada online no mês passado.

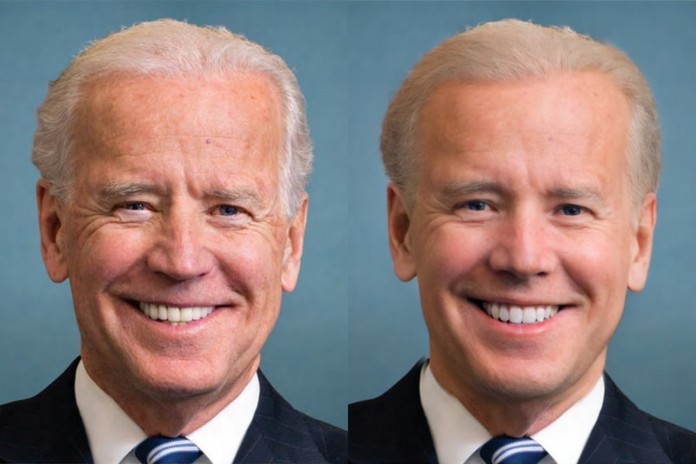

Exemplos concorrentes são entradas ligeiramente alteradas que fazem com que sistemas de inteligência artificial, como modelos de aprendizado de máquina, cometam erros. Além disso, a equipe mostrou que o ataque ainda funciona após a compactação do vídeo. No vídeo acima, os cientistas mostram que o XceptionNet, um detector deepfake, rotula o vídeo concorrente como "real".

A maioria desses detectores funciona rastreando rostos em um vídeo e enviando os dados do rosto recortado para uma rede neural para análise. A rede neural então analisará esses dados e encontrará elementos que geralmente são mal reproduzidos em deepfakes, como o flickering.

Ao inserir exemplos concorrentes, os pesquisadores descobriram que podiam enganar esses detectores de deepfake fazendo-os acreditar que os vídeos eram reais.

Eles afirmam no artigo que “para usar esses detectores de deepfake na prática, é importante avaliá-los contra um adversário adaptativo que está ciente dessa proteção e tenta quebrá-la deliberadamente. Mostramos que os métodos modernos de detecção de deepfake podem ser facilmente ignorados se o invasor estiver totalmente ou parcialmente ciente do detector."

Como esses cientistas mostraram, as tecnologias de automação que estão sendo desenvolvidas para combater a desinformação podem ainda não estar à altura da tarefa.

Leia também: